L’avanzamento intempestivo dell’intelligenza artificiale sta imponendo richieste senza precedenti alle infrastrutture dati tradizionali, costringendo le aziende del settore bancario, dei servizi finanziari e assicurativo (BFSI) a scegliere tra sicurezza, qualità e sostenibilità. È quanto emerge da un nuovo sondaggio di Hitachi Vantara, azienda controllata da Hitachi Ltd. (TSE: 6501) focalizzata sulle soluzioni di archiviazione dati e sulle infrastrutture abilitanti per l’Hybrid Cloud. Il report State of Data Infrastructure 2024 che riflette le opinioni fornite da 231 leader finanziari IT e aziendali a livello globale, ha rilevato che, sebbene il 36% riconosca l’importanza della qualità dei dati per il successo dell’AI, la priorità dei financial leader si focalizza sulla sicurezza dei dati, con conseguenti lacune nelle prestazioni dell’IA e nel ritorno degli investimenti a lungo termine.

Dati chiave del report sui settori Bancario, Servizi Finanziari e Assicurativo

Il 48% degli intervistati indica la sicurezza dei dati come la principale preoccupazione nell’implementazione dell’IA, evidenziando la necessità critica di proteggersi da minacce interne ed esterne. Tuttavia, i risultati dello studio mostrano che ignorare la qualità dei dati comporta costi per le istituzioni BFSI, tra cui:

- Nelle aziende BFSI, i dati sono disponibili solo quando e dove sono necessari per un quarto del tempo (25%) con la ricaduta che i modelli di intelligenza artificiale BFSI sono accurati solo nel 21% dei casi.

- Il 36% è preoccupato per il rischio di una violazione dei dati causata dall’IA interna, mentre il 38% teme l’impossibilità di recuperare i dati a seguito di un attacco ransomware.

- Sebbene gli attacchi ransomware siano una delle principali preoccupazioni per i responsabili IT del settore BFSI, il 36% considera una violazione dei dati causata da un errore dell’IA tra le tre principali minacce, mentre il 32% teme che un attacco AI-enabled possa provocare una violazione dei dati.

“Il modello di business nei servizi finanziari è intrinsecamente legato alla fiducia. Il danno reputazionale rappresenta un rischio significativo e, nel nostro settore, l’interazione tra sicurezza e accuratezza è una sfida critica e complessa”, ha dichiarato Mark Katz, CTO of Financial Services, Hitachi Vantara “Ad esempio, se un chatbot divulga inavvertitamente informazioni sensibili presenti nei dati di training, le conseguenze possono essere gravi. Inoltre, il costo di una risposta errata o di un’allucinazione rappresenta un rischio significativo: se qualcuno agisse basandosi su dati sbagliati, si aprirebbero una serie di questioni legate alla responsabilità.”

Quando l’implemento dell’AI non è preceduto da una preparazione adeguata

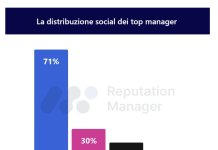

Nonostante le sfide legate all’accuratezza, l’adozione dell’IA nel settore BFSI sta accelerando, anche se molti stanno implementando l’IA senza una preparazione adeguata:

- il 71% degli intervistati ammette di testare e apportare modifiche direttamente sulle implementazioni live,

- mentre solo il 4% utilizza ambienti sandbox controllati.

- La ricerca conferma che i leader dei servizi finanziari ritengono che la qualità dei dati sia l’aspetto più importante per un’implementazione efficace dell’IA, ma preoccupazioni come la sicurezza sono troppo urgenti per essere ignorate, con un impatto negativo sul ritorno degli investimenti.

«Sebbene la rapida adozione dell’IA generativa nel settore dei servizi finanziari sia un fenomeno interessante, gli istituti finanziari devono adottare un approccio strategico», ha affermato Alenka Grealish, co-head Generative AI Intelligence, Celent. «Le imprese devono bilanciare velocità e innovazione mantenendo un focus su sicurezza, accuratezza e responsabilità etica. Quelle che daranno priorità a una pianificazione attenta e a solide strutture non solo mitigheranno i rischi, ma sbloccheranno anche tutto il potenziale dell’IA generativa per favorire una crescita sostenibile e un vantaggio competitivo. In questo modo, costruiranno una fiducia duratura con i loro stakeholder».

Prepararsi per il futuro

L’indagine evidenzia i principali aspetti da considerare per costruire un’infrastruttura più resiliente e AI-ready, aiutando le organizzazioni del settore BFSI a prepararsi per il futuro, tra cui:

- Sperimentazione responsabile: Due leader su cinque nel settore BFSI (42%) hanno dichiarato di sviluppare le competenze necessarie per implementare l’IA attraverso la sperimentazione. Test responsabili in ambienti sicuri possono ridurre i rischi e, al contempo, rivelare il potenziale dell’IA.

- Sostenibilità a ogni livello: dall’archiviazione dati a basso consumo energetico al software ottimizzato, i leader aziendali e IT devono integrare fin dall’inizio un approccio sostenibile nella loro infrastruttura, nelle applicazioni, nei modelli, nelle pratiche di gestione dei dati e nelle strategie.

- Semplificare e unificare i sistemi: ridurre la complessità gestendo in modo uniforme gli ambienti ibridi, automatizzando le attività di sicurezza e sfruttando piattaforme dati unificate per ottenere insight più rapidi e ottimizzare l’AI training.

- Garantire la resilienza dei dati e sfruttare l’IA per la difesa: pianificare il ripristino con sistemi di ridondanza, roll-back storage e ripristino dei modelli IA per mitigare i rischi derivanti da guasti o attacchi. Utilizzare l’IA per identificare i rischi, migliorare il recovery e proteggere i dati con storage immutabile, crittografato e self-healing, contrastando le minacce AI-enabled.

Basato sul Global State of Data Infrastructure Survey 2024 di Hitachi Vantara, questo report raccoglie le opinioni di 231 specialisti BFSI, executive C-level e decision-maker IT provenienti da 15 paesi in tutto il mondo.