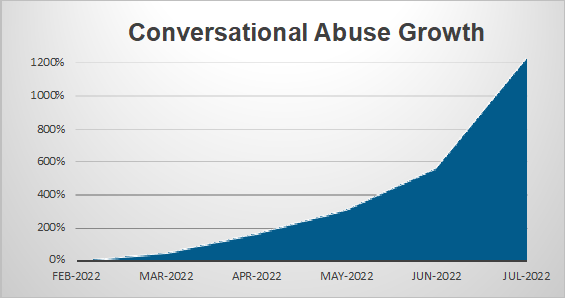

Le truffe conversazionali stanno colpendo molte vittime spesso ingenue e ignare del pericolo che si cela dietro un messaggio all’apparenza innocuo, e il fenomeno non accenna ad arrestarsi. Anzi, le truffe conversazionali sono state la minaccia mobile in più rapida crescita del 2022. A differenza del phishing convenzionale o dell’invio di malware, questi attacchi si sviluppano attraverso una serie di interazioni apparentemente benevole fino a conquistare la fiducia della vittima. Secondo i dati di Proofpoint, questa tecnica ha registrato un aumento delle segnalazioni di 12 volte ed è stata visibile su numerose piattaforme diverse, tra cui SMS, app di messaggistica e social media.

Questa crescita ha fatto sì che le minacce conversazionali diventassero la categoria di abuso mobile più alta per volume, superando la consegna di pacchi, l’impersonificazione e altri tipi di frode in alcuni settori verticali. La crescita delle minacce di truffe conversazionali non mostra segni di rallentamento ed è continuata anche nel primo trimestre del 2023.

Stuart Jones, Director, Cloudmark Division di Proofpoint, afferma: “L’abuso di conversazioni attraverso SMS e social media è particolarmente preoccupante perché gli attori delle minacce spendono tempo (spesso settimane) e sforzi per costruire un rapporto di fiducia con le loro vittime mirate, avviando quella che inizia come una conversazione via messaggio innocua e benigna, progettata per ingannarle, aggirando così le difese tecniche e umane. Esistono molte varianti di questi attacchi e gli utenti di telefonia mobile dovrebbero essere molto scettici nei confronti di qualsiasi messaggio proveniente da mittenti sconosciuti, soprattutto considerando come gli strumenti di intelligenza artificiale stiano rendendo possibile per i cybercriminali rendere i loro attacchi più realistici che mai”.

Stuart Jones, Director, Cloudmark Division di Proofpoint, afferma: “L’abuso di conversazioni attraverso SMS e social media è particolarmente preoccupante perché gli attori delle minacce spendono tempo (spesso settimane) e sforzi per costruire un rapporto di fiducia con le loro vittime mirate, avviando quella che inizia come una conversazione via messaggio innocua e benigna, progettata per ingannarle, aggirando così le difese tecniche e umane. Esistono molte varianti di questi attacchi e gli utenti di telefonia mobile dovrebbero essere molto scettici nei confronti di qualsiasi messaggio proveniente da mittenti sconosciuti, soprattutto considerando come gli strumenti di intelligenza artificiale stiano rendendo possibile per i cybercriminali rendere i loro attacchi più realistici che mai”.

Come funzionano le truffe conversazionali?

Crescita delle minacce conversazionali, 2022

Proofpoint ha già trattato l’emergere di minacce di truffe conversazionali via e-mail in passato. Sia nella posta elettronica che nelle comunicazioni mobile, l’interazione tra attaccante e vittima inizia con un messaggio apparentemente innocuo. Se l’utente abbocca all’amo, l’aggressore può passare giorni o addirittura settimane a scambiarsi messaggi apparentemente innocenti prima di tentare di rubare informazioni, denaro o credenziali.

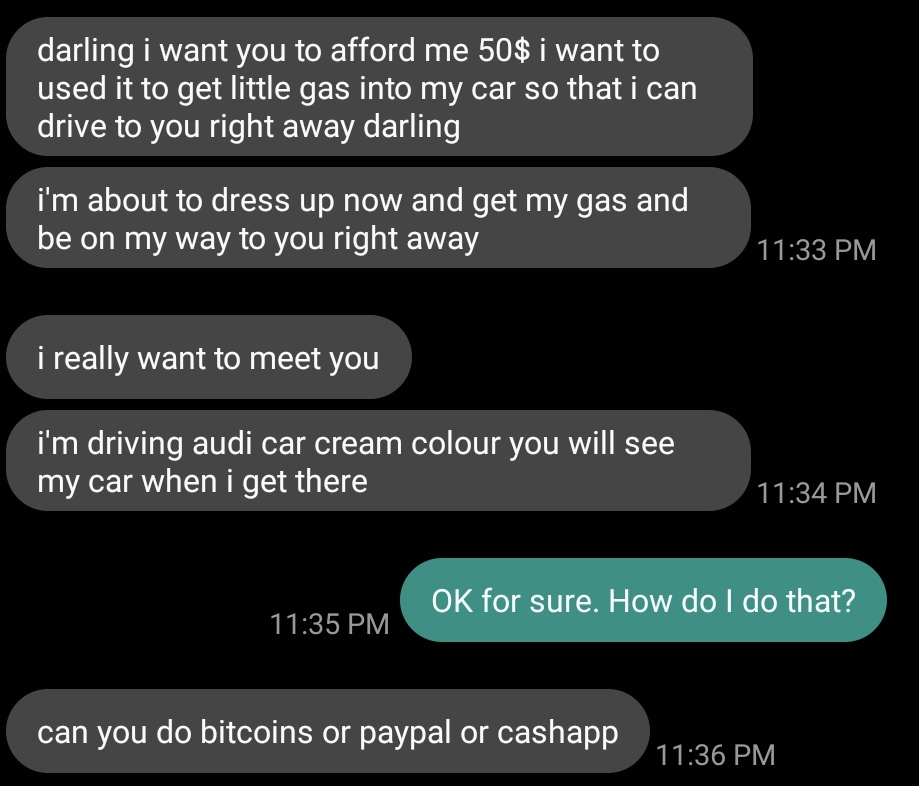

Queste truffe conversazionali sono in realtà una forma di social engineering. Abili manipolatori sfruttano l’ubiquità delle comunicazioni mobili per gettare la rete e raggiungere il maggior numero possibile di vittime. In questo senso, le minacce conversazionali sono come le frodi con pagamento anticipato dei primi tempi di Internet. In quegli attacchi, gli indirizzi e-mail venivano inviati via spam con l’offerta di un grosso guadagno in cambio dell’aiuto di un estraneo per sbloccare un investimento o un’eredità. È cambiato il meccanismo di consegna e il fatto che la somma promessa è ora rappresentata da Bitcoin o Ethereum.

Parlare può avere un costo

Il fatto che i malintenzionati abbiano adottato esche conversazionali nella posta elettronica e telefonia mobile, sia negli attacchi a sfondo finanziario che in quelli sponsorizzati da uno Stato, suggerisce come questa tecnica sia efficace. La ricettività della società nei confronti dei messaggi a mobile la rende un vettore di minaccia ideale, poiché tendiamo a leggere i nuovi messaggi entro pochi minuti dalla loro ricezione.

Nell’ultimo anno, una varietà di attacchi nota come “pig butchering” è balzata agli onori della cronaca per le ingenti quantità di criptovaluta perse dalle vittime. Il nome è nato in Cina, ma l’FBI ha recentemente notato un forte aumento del numero di vittime statunitensi. L’anno scorso, gli americani hanno perso più di 3 miliardi di dollari a causa di truffe conversazionali legate alle criptovalute, di cui questa è uno dei principali esempi. Naturalmente le truffe amorose, le frodi lavorative e altre forme di attacco conversazionale di vecchia data sono ancora presenti nel panorama delle minacce.

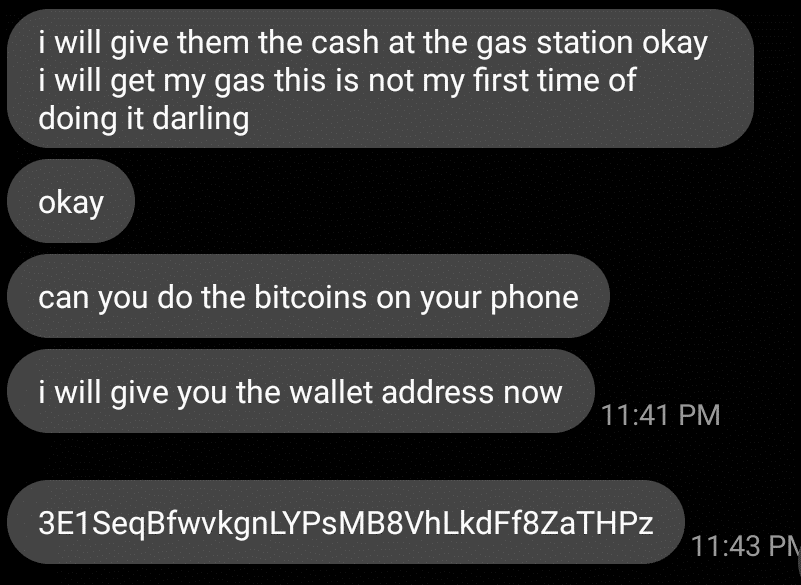

La conclusione di una truffa sentimentale: il portafoglio Bitcoin ha ricevuto oltre 2.500 dollari in Bitcoin.

Oltre alle perdite finanziarie, questi attacchi comportano anche un impatto significativo sulle persone. Nel caso del pig butchering e delle truffe sentimentali si registra un investimento emotivo da parte della vittima. La fiducia viene guadagnata e poi abusata, il che può provocare sentimenti di vergogna e imbarazzo, oltre alla conseguenza reale della perdita di denaro.

Truffe conversazionali basate sulla IA

Grazie ai recenti progressi dell’intelligenza artificiale generativa, i truffatori conversazionali potrebbero non avere più bisogno dell’aiuto umano. Il rilascio di strumenti come ChatGPT, Bing Chat e Google Bard preannuncia l’arrivo di un nuovo tipo di chatbot, in grado di comprendere il contesto, mostrare ragionamenti e persino tentare la persuasione. In prospettiva, i bot IA addestrati a comprendere codici fiscali e strumenti di investimento complessi potrebbero essere utilizzati per frodare anche le vittime più attente.

In alto, una comune immagine di pig butchering. In basso, un’immagine simile, ma unica, generata per questo post utilizzando Midjourney.

In alto, una comune immagine di pig butchering. In basso, un’immagine simile, ma unica, generata per questo post utilizzando Midjourney.

Insieme a modelli di generazione di immagini in grado di creare foto uniche di persone reali, gli attori delle truffe conversazionali potrebbero presto utilizzare l’IA come complice criminale a tutti gli effetti, creando tutte le risorse di cui hanno bisogno per far cadere in trappola le vittime e frodarle. Con i progressi della tecnologia deepfake, che utilizza l’IA per sintetizzare contenuti audio e video, la tecnica pig butchering potrebbe un giorno passare dalla messaggistica alle chiamate, aumentandone ulteriormente la persuasività.

Si tratta di un tema molto ampio e di un’area del panorama delle minacce in rapido sviluppo, sia da parte degli attaccanti che dei difensori, su cui vedremo sicuramente evoluzioni degne di nota.