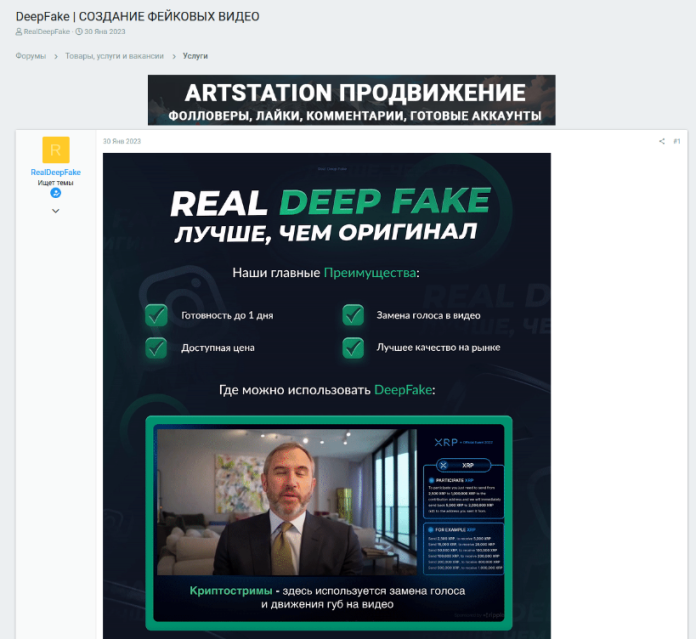

L’intelligenza artificiale generativa è ormai in grado di produrre immagini quasi indistinguibili da fotografie reali. Questi contenuti, noti come deepfake, sollevano crescenti preoccupazioni per il loro potenziale utilizzo in truffe e campagne di disinformazione.

Uno degli aspetti più critici riguarda la manipolazione delle cosiddette “impronte digitali dell’IA”, ovvero tracce invisibili che permettono di identificare l’origine di un’immagine. Tali impronte possono essere rimosse o alterate con relativa facilità, rendendo estremamente difficile stabilire se un contenuto sia stato generato artificialmente. In alcuni casi, è persino possibile modificarle per far apparire un’immagine come prodotta da un modello diverso, aprendo la strada a possibili falsi attribuiti ai danni di aziende tecnologiche.

Per contrastare questi rischi, si stanno sviluppando soluzioni basate sul miglioramento delle tecniche di rilevamento e sull’uso della filigrana digitale, che consiste nell’inserimento di firme invisibili all’interno dei contenuti generati dall’IA. In particolare, il rilevamento delle impronte digitali rappresenta un approccio promettente: analizzando pattern nascosti lasciati dai modelli, consente di risalire al sistema che ha generato l’immagine.

Rimozione delle impronte digitali

Tuttavia, nuove ricerche evidenziano la fragilità di queste tecniche. Un gruppo di scienziati dell’Università di Edimburgo ha dimostrato che le impronte digitali dell’IA possono essere rimosse o manipolate attraverso diversi tipi di attacco.

Lo studio ha inizialmente valutato la sicurezza dei metodi di rilevamento esistenti, per poi sviluppare attacchi avversariali capaci di eliminare o falsificare le impronte in vari scenari di minaccia. Questi andavano da attaccanti con pieno accesso ai modelli di generazione delle immagini fino a soggetti con risorse limitate e senza accesso privilegiato.

Nel complesso, i ricercatori hanno testato 12 generatori di immagini e 14 tecniche di rilevamento, realizzando una delle valutazioni più ampie mai condotte in questo ambito.

I risultati mostrano che, sebbene molti metodi siano altamente accurati nel rilevare immagini non alterate, la loro efficacia diminuisce drasticamente quando le immagini vengono manipolate. La rimozione delle impronte si è rivelata particolarmente efficace: il tasso di successo supera l’80% per attaccanti esperti e rimane superiore al 50% anche in scenari più semplici.

In alcuni casi, sono sufficienti operazioni comuni come la compressione JPEG, il ridimensionamento o la sfocatura per compromettere completamente le impronte digitali.

Anche la falsificazione delle impronte — ovvero l’attribuzione errata del modello generativo — rappresenta una minaccia concreta. Sebbene meno efficace della rimozione, ha comunque mostrato vulnerabilità in circa metà dei sistemi analizzati.

Un elemento particolarmente preoccupante è che tutti questi attacchi risultano impercettibili all’occhio umano, senza lasciare segni visibili sulle immagini. Inoltre, nessuna delle tecniche esaminate è stata in grado di garantire contemporaneamente alta accuratezza e robustezza in tutti gli scenari.

Comprendere i limiti degli approcci attuali è fondamentale per sviluppare sistemi più affidabili. In questo contesto, l’integrazione tra rilevamento delle impronte e filigrana digitale potrebbe rappresentare una strada efficace per migliorare l’identificazione dei deepfake.

I risultati dello studio sono stati sottoposti a revisione tra pari e saranno presentati alla Conferenza IEEE sulla Machine Learning Sicura e Affidabile (SaTML), in programma a Monaco di Baviera.

La ricerca è stata supportata dall’Edinburgh International Data Facility, dal Data-Driven Innovation Programme e dal Generative AI Laboratory dell’Università di Edimburgo.

Kai Yao, dottorando presso la School of Informatics e coautore dello studio, ha commentato: «Siamo rimasti sorpresi dalla fragilità di queste impronte digitali. Ci aspettavamo che attacchi sofisticati fossero efficaci, ma scoprire che semplici modifiche quotidiane possano cancellare le prove forensi è stato un campanello d’allarme. Questo suggerisce che molti sistemi di rilevamento potrebbero fallire nel momento in cui le immagini vengono condivise o modificate nel mondo reale».

Sulla stessa linea, Marc Juarez, docente di Sicurezza Informatica e Privacy e coautore, ha sottolineato: «Implementare queste tecniche senza considerare le minacce reali può generare un falso senso di sicurezza. Se vogliamo usarle per responsabilizzare gli attori malevoli, dobbiamo garantire che le impronte non siano facilmente manipolabili. Qualsiasi strumento di questo tipo diventa inevitabilmente un bersaglio. È quindi essenziale integrare la robustezza agli attacchi nei criteri di valutazione, andando oltre la semplice ottimizzazione delle prestazioni».